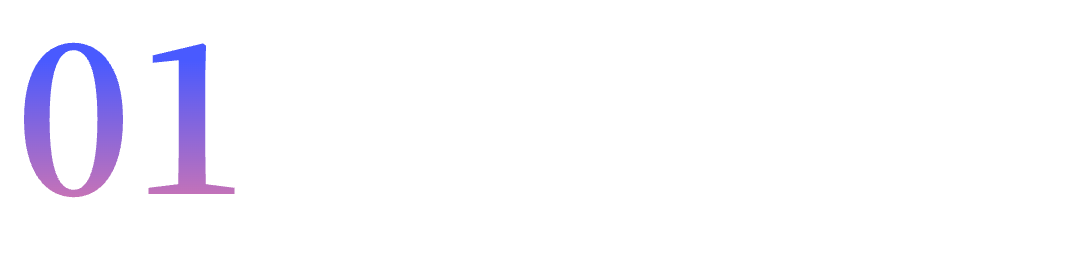

大模型会写诗写代码,却不会倒水开门。李飞飞万字长文指出:AI真正的下一站,不是语言智能,而是空间智能——理解世界、预测变化、参与行动,才是真正的智能革命。编辑:前沿在线 编辑部

为什么我们在讨论“空间智能”?

过去几年,大模型的快速演化让我们习惯了一个“说得越来越像人”的AI世界。它能写文案、能画图、能编代码、能演讲、能陪聊,仿佛进入了智能的黄金时代。

但当我们真正问自己一个问题:“这些AI,能走进现实世界吗?”答案依然是——还远着呢。

它能写出十种喝水的方式,却倒不好一杯水。它能生成极美的卧室图,却连“开门进房间”的物理结构都不理解。它能模拟医生问诊,却不会扶老人过马路。

这并不是AI不够聪明,而是它的“聪明”停留在一种语言层面:理解句子、预测词语、生成符号。这种“认知智能”,其实是一种“屏幕里的智能”。

李飞飞这篇万字长文中反复强调一点:AI 革命走到了一个被语言“封印”的天花板上。

现在的 AI,看起来能言善道,但实际上像“黑暗中的文豪”,对世界毫无经验。她直言:“AI 只会描述世界,但它不会生活在世界里。”

而要让 AI 真正走进物理世界,具备“行动力”,空间智能(Spatial Intelligence)就是我们必须跨过的下一个台阶。

人类智能的起点:不是语言,而是空间

我们通常以为,语言是人类智能的起点。

但李飞飞提醒我们,事实刚好相反。一个婴儿在学会说话之前,就已经会做很多事了:抓玩具、摸轮廓、扔东西、摔东西,甚至盯着水滴滚落发呆。

表面上看,这只是好奇心,实际上,这是空间智能在生长——通过观察与试错,婴儿在“身体力行”地理解世界的规则。

空间智能,不是用来说话的,而是用来活着的。

在日常生活中,我们每一项动作,几乎都建立在对空间的直觉理解上:停车靠边,要判断轮胎与马路牙子的距离;接住飞来的钥匙,需要估算速度与轨迹;

不看杯子倒水,依赖的是对物体形状和位置的记忆。这些事情我们做得毫不费力,但背后都涉及复杂的空间计算。

更重要的是,人类文明的重大跃迁,往往就靠这类“空间感”触发灵感。古希腊的埃拉托色尼通过观察太阳影子的角度,测出了地球的圆周;

18世纪的哈格里夫斯将多个纺锤并列排布,创造出纺织效率提升八倍的“珍妮纺织机”;沃森与克里克则在摆弄铁丝模型中,摸索出 DNA 的双螺旋结构——这些伟大发现,不是“算”出来的,是“看”出来、是“摆”出来的,是靠空间理解而非语言逻辑建构的。

李飞飞说得直接:空间智能是行动的基础,而不是表达的产物。语言帮助我们沟通,但空间理解才帮助我们生存、创造和进步。

为什么当前AI不具备空间智能?

尽管我们已经拥有了令人惊叹的AI语言能力、图像生成能力和代码编写能力,但在“理解世界”这件事上,它依然像个纸上谈兵的孩子。

李飞飞指出,今天的大模型,学到的是“语言的皮肤”,不是“世界的骨架”。

这是因为当前AI的主流学习方式,都是基于“符号”——文字、标签、像素,它们学习的是词与词的关系、图与图的相似度,而不是物体与空间之间的真实互动关系。

它们并不知道“水会流下来”、“影子在光照下会变形”、“玻璃是透明的”,它们只是根据训练数据生成“看起来像的东西”。

于是你会发现,AI生成的图像虽然精美,但常出现奇怪的物理错误:水从杯子外流出来、影子方向反了、手有六根指头。这不是算力的问题,而是“没有物理常识”的问题。

再看机器人,表面上已经能抓取、能行走,甚至能“装配零件”,但这些行为大多建立在“高度定制”的环境里——比如专用轨道、特定参数、脚本控制。换个场景,它就“手忙脚乱”。

机器人无法像人类那样在复杂环境中做出泛化判断,更无法真正理解“物体之间的关系”和“下一步该怎么做”。

AI在屏幕里看起来很聪明,一旦进入现实世界,就会暴露“空间盲点”:不会判断距离、不会识别障碍、不会预测结果。

李飞飞说,这是因为它们没有“住在世界里”,它们只是“读取了关于世界的描述”。而要让AI真正走出“屏幕边界”,它需要的不只是看图说话,而是“参与世界”的能力。

这,正是空间智能的起点。

世界模型:让 AI 走出屏幕,进入现实

如果说语言智能让AI学会“说话”,那么世界模型(World Models),就是让AI开始“做事”的关键。

李飞飞在文章中提出,空间智能的核心载体,不是多模态大模型,而是具备世界建模能力的生成模型——这是一种全新的AI范式,它不再只生成文本、图片或视频,而是生成一个“可以持续存在、可以交互变化”的世界。

AI第一次从“语言描述”走向“物理构建”。

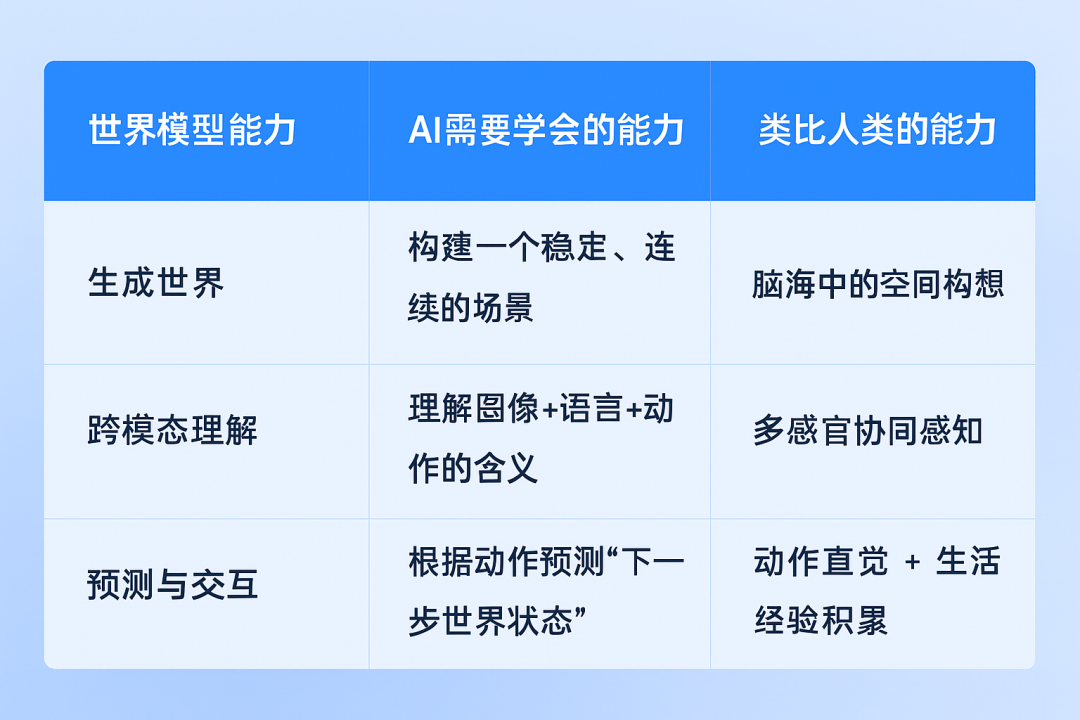

她将世界模型的核心能力,拆解为三大要素,我们可以用一张“人类类比表”来帮助理解:

这背后的转变非常关键:传统大模型训练的是“下一句文本”,世界模型训练的则是“下一帧世界状态”。

这意味着,AI不再是复述者、描述者,而是变成了一个“参与者”、“构建者”,甚至是“行动者”。

想象一下:你告诉AI“请帮我布置一个适合8人聚会的客厅”,它不仅生成图纸,而是直接生成一个完整、可交互的3D场景;

你说“把水壶拿给我”,它不是理解“语言”,而是理解你与水壶的空间关系,预测路径、避障、抓取、递交——这一切依赖的不是语言,而是具身感知+空间推理+行为预测的整体智能。

李飞飞创立的 World Labs 正是在做这件事。

他们开发的 Marble 系统,正是一个能接收多模态输入(语言、图像、动作指令),并生成一致的3D交互场景的世界模型系统。

Marble 不再只是“生成画面”,而是能“维持一个世界”,让用户在里面走动、探索、建构。

世界模型,是让AI走出屏幕、进入现实的通道。它将AI从“会讲故事”进化为“能创造世界”的新物种。

空间智能会重做哪些行业?

当AI拥有空间智能,它就不再是一个“内容生成器”,而变成一个“现实世界的协作伙伴”。李飞飞认为,这种能力的落地将带来四个最重要的行业变革方向:

1)创意产业:从“画画”到“构建世界”

过去的AI创作,是生成图像、生成音乐、生成短片——它们都停留在二维屏幕里。空间智能的加入,让创作从“表现”走向“构建”。

导演可以直接生成一个可进入、可漫游的虚拟电影场景,而不是靠绿幕加后期;

游戏开发者可以快速模拟多种物理互动机制,加速剧情与环境的迭代;

建筑师可以提前“走进”尚未建成的空间,对结构与流线做出更人性化的优化。

这一切的前提是:AI能理解空间逻辑、构建三维世界,并支持与人互动。

李飞飞举了一个生动的例子:过去我们是用图纸“想象房子”,未来我们是“在AI生成的房子里走一圈再决定改哪里”。

2)机器人:从工具,走向协作伙伴

如果说空间智能是AI的核心感知能力,那么机器人就是其行动延伸。

未来的机器人,不再是机械臂、仓储搬运、流水线操作员,而是具备空间理解力的“行动者”与“助手”。

比如家庭助手:它能理解你“刚喝完水”的动作,就去厨房拿水壶补满杯子,而不是等你下指令;

比如实验室助手:它能自主协作实验流程,把研究者从重复性的操作中解放出来。

这种“看懂人+理解空间+预测行动”的协作能力,正是空间智能带来的跃迁。

AI不是拿来“替你做事”的,而是“跟你一起做事”的。

3)科学与医疗:多维模拟,加速突破

很多科学突破依赖的是空间结构的直觉。

例如药物开发,研究者需要理解分子的三维结合机制;材料设计,需要评估结构变化对性能的影响;医疗影像,需要医生在脑海中重建器官与病变位置。

空间智能 AI,可以在这些环节中扮演关键角色:它可以模拟无数可能的空间组合,加速推演,缩短试错周期。甚至在手术前,AI可以基于患者CT/MRI影像生成全息模型,让医生“预演手术”,提升成功率。

这是“从理解语言,到理解物体”的跨越,也是AI真正参与到“理解世界结构”的开始。

4)教育:抽象知识,沉浸式体验

空间智能,还会深刻改变教育方式。过去我们靠想象力“理解原子结构”“看懂地球公转”“学习电磁场的方向”。

但对于很多学生来说,这些“看不到、摸不着”的知识,始终停留在记忆层面。

而拥有空间智能的AI,可以构建沉浸式教学场景:让你走进细胞内部、绕着DNA结构飞一圈、在古战场上穿梭、在数学几何中旋转。

知识不再是讲述的,而是“进入”的。

教育变成一场“空间旅程”,不仅提升理解,更激发好奇心。

李飞飞总结得很清晰:空间智能不是炫技,而是真正的“新型生产力”。它重构的不只是工具,而是重塑“人如何与世界互动”的方式。

为什么李飞飞强调“增强人,而不是替代人”?

当“AI会说话”这件事变得越来越自然,我们开始焦虑“它是不是要抢我的工作”。

而李飞飞在这篇万字长文中反复强调一个基本立场:“AI不是来替代人类的,而是来增强人类的。”

语言模型的崛起,让不少职业变得不安全——写PPT、写邮件、写脚本似乎都可以被AI代劳。

但这正是“语言智能”的局限:它只能处理符号,无法理解动机、情境与人本身。

而空间智能带来的AI,则走向了另一个方向:从“替代”走向“协作”。李飞飞举了许多例子:

- 在护理机构中,AI可以协助照护人员进行环境监控、搬运、提醒等操作,但不会剥夺老人的生活自主权。

- 在科研实验室中,AI机器人可以代替人类完成高度重复、标准化的操作,但发现科学规律的核心思考,依然由人来完成。

- 在设计创作中,AI可以帮助快速生成空间草图与可交互场景,但真正有情感、有文化语义的“表达”,仍然需要人类的灵感点燃。

这是一个本质性的理念差异:语言AI是“你说我做”,而空间AI是“你做我帮”。

后者强调配合、补位与增强——正如她所说的:“AI 的价值,不是取代人类的劳动,而是让我们做到原本做不到的事。”

这种“人机协作”的价值观,不仅是李飞飞20多年AI研究者身份的总结,也是她在创业中亲自实践的底层信念。

她不谈AGI神话,也不渲染AI末日,她只关心一件事:AI要如何为人类赋能,为人的尊严、能力与选择,留出更大的空间。

AI 的未来不是更好说话,而是更会做事

我们已经见证了语言智能带来的“认知革命”——从GPT-3到GPT-4,再到多模态模型如GPT-4V、Claude 2、Gemini Ultra,AI变得越来越能说、越来越能写。

但李飞飞在这篇文章中提醒我们:真正的智能,不止于“说得漂亮”,更要“做得正确”。

空间智能,将开启另一场“行动革命”。它让AI不再是坐在屏幕后讲道理的“语文课代表”,而是走到现实中和人协同的“实习工程师”、”助理科学家“、”家庭照护员“、”创意导演“。

我们可以这样描绘未来AI的三重跃迁:

- 从阅读世界:AI能理解人类语言、图像、视频等符号信息;

- 到理解世界:AI能建立空间模型、推理物理关系、预测动态;

- 再到建设世界:AI能创造、操作、协同,成为现实行动的参与者。

这正是从“Words”走向“Worlds”的进化。

而这场进化,也正是李飞飞提出的下一站AI:空间智能的意义所在。

不是为了打造另一个神一样的AGI,而是为了让人类更自由地生活、创造与关怀;不是为了更快地替代人类,而是更深地增强人类。

真正的智能,不是能背多少书,而是能用知识去触碰现实。

真正的未来,不是更好说话,而是更会做事。

真正的AI,不是造一个语言的宇宙,而是建一个理解世界、参与世界的“新物种”。

这,就是李飞飞心中,AI的下一站。